Il confine sfocato tra sicurezza e controllo

di Giuseppe Miccoli

Il 26 ottobre 2023 è una data che segnerà il futuro della rete nel Regno Unito, ma anche altrove. Quel giorno è entrato in vigore l’Online Safety Act, una delle legislazioni più ambiziose — e controverse — mai varate in Europa per regolamentare i contenuti online.

La legge nasce con un intento dichiarato: proteggere gli utenti, soprattutto i minori, dalla violenza digitale. Ma lo strumento scelto è stato drastico. Il provvedimento impone alle piattaforme social — ma anche ai servizi di messaggistica — obblighi stringenti di moderazione, minacciando sanzioni fino a 18 milioni di sterline o il 10% del fatturato globale per chi non si adegua.

Ma non è tutto. L’atto introduce un concetto inquietante: la categoria dei contenuti “legali ma dannosi”. Cosa significa? Che esistono messaggi, immagini, parole che non violano formalmente alcuna legge, ma che potranno comunque essere rimossi o oscurati. Il criterio diventa soggettivo, e la rete rischia di piegarsi a logiche ambigue.

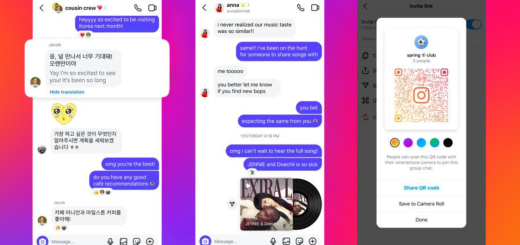

L’altro punto critico è la scansione dei messaggi privati, anche su canali crittografati come WhatsApp, Telegram o Signal. Il governo britannico vuole che le piattaforme siano in grado di individuare materiali pedopornografici o terroristici anche prima che vengano segnalati. Una richiesta che collide frontalmente con il principio della crittografia end-to-end, base della sicurezza di milioni di conversazioni.

Meta, Apple, Signal e altri colossi tech hanno protestato. “È come installare una videocamera in ogni casa”, hanno dichiarato. Ma il governo non ha ceduto. La sicurezza, dicono, viene prima della privacy. Il risultato è un cortocircuito: per proteggere gli utenti da potenziali pericoli, si mette in pericolo il diritto alla riservatezza di tutti.

È una legge pensata per tempi complessi, certo. Ma la storia insegna che le tecnologie di sorveglianza, una volta introdotte, raramente vengono disattivate. Il rischio è che si apra la strada a un controllo permanente, che trasforma la tutela in disciplina.

Nel Regno Unito, da oggi, i gestori di piattaforme dovranno non solo togliere ciò che è illegale, ma anche decidere cosa è inopportuno. E dovranno farlo con algoritmi, moderatori automatizzati, filtri comportamentali. In nome del bene, si disegna un web più chiuso, meno libero, più controllato.

C’è davvero da sentirsi più al sicuro? Oppure stiamo solo abituandoci, un passo alla volta, a vivere sotto osservazione continua, in un ambiente che ci promette protezione, ma ci priva della libertà di sbagliare, esplorare, dissentire?

La domanda resta sospesa nella rete.